可以用ChatGPT写的程序赚钱吗?——AIGC的基础法律问题透视

ChatGPT and AIGC: Fundamental Legal Issues

可以用ChatGPT写的程序赚钱吗?——AIGC的基础法律问题透视

ChatGPT and AIGC: Fundamental Legal Issues

ChatGPT最近算是彻底火出了圈。

作为一款由OpenAI开发的人工智能聊天软件,该程序受到诸多专业人士高度评价,被认为是具有革命性意义的产品。

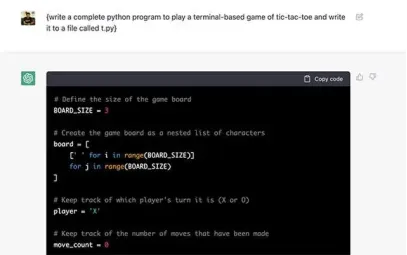

和之前的那些聊天机器人相比,ChatGPT像是一位我们理想中的AI顾问。你可以用聊天一样自然的语言,向ChatGPT提出各种比较实际的要求。 比如,你让它写个视频脚本,它会根据主题给你列出各种要点;你询问它如何系统地学习和了解一门知识,它会给你搭出一个相对清晰的知识框架;就算你毫无编程基础,也可以用ChatGPT编出一个立刻就能跑的程序。

用ChatGPT写一个井字棋游戏

1 用ChatGPT写小程序居然还可以赚钱

在笔者和朋友闲聊之中,得知对方使用ChatGPT生成的代码已经开始盈利了。在感慨对方轻而易举赚钱的同时,也引起了笔者的思考:普通的小程序代码作为作品受到著作权保护,但是ChatGPT生成的代码是否可以作为作品受到著作权保护呢?同时,使用ChatGPT生成的代码,著作权属于笔者的朋友吗?如果不属于,使用这个小程序进行盈利的行为,是否是侵犯其他人的权益呢?对于这一系列ChatGPT产物所延伸出来的著作权问题,本质上便是长期以来备受关注的人工智能生成物的保护问题。

2 人工智能生成物能否构成作品

对于人工智能生成物能否构成著作权意义上的作品,无论是学术界还是已有司法实践,争议颇大,不同观点的结论甚至截然相反。

(一)关于作品认定的法律条文

法律规定层面,

《著作权法》第3条 :本法所称的作品,是指文学、艺术和科学领域内具有独创性并能以一定形式表现的智力成果。依据该条有关作品的定义中可以看出,要构成著作权法意义上的作品至少需要符合三个要件:

在文学、艺术和科学领域内智力成果; 具有独创性; 能以一定形式表现。

但该条并没有明确规定自然人创作是作品的构成要件,但在一些地方司法文件中,如 《北京市高级人民法院侵害著作权案件审理指南》明确要求必须是基于自然人创作成果,才可以认定为作品 。

如前述指南第2.1【是否构成作品的审查】明确规定:审查原告主张著作权的客体是否构成作品,一般考虑如下因素 (1)是否属于在文学、艺术和科学范围内自然人的创作; (2)是否具有独创性; (3)是否具有一定的表现形式; (4)是否可复制。

(二)学界关于人工智能生成物能否构成作品的观点

在学术界,就人工智能生成物能否构成作品,有诸多不同观点。

1.人工智能生成物不构成作品

王迁教授 从人工智能生成物的产生过程出发,认为迄今为止人工智能生成物都是应用算法、规则和模板的结果,并不属于创作,不能体现创作者独特的个性,并不能被认定为作品,自然无需再去讨论作者。[3]

邱润根教授 坚持自然人创作是构成作品的前提。[4]

刘银良教授 则在坚持此观点的基础上质疑人工智能生成物作为作品所带来的思想价值与情感意义, 认为其无助于实现著作权制度的基本目标,不应作为作品来保护。[5]

陶乾教授 在坚持主观作者主义的独创性判断标准的基础上,认为承认人工智能生成物构成作品会违背传统的著作权法理,因此人工智能生成物不构成作品。[6]

2.****人工智能生成物可以构成作品

以李扬教授为代表的“工具说”认为 ,人工智能只是辅助人创作的工具,人工智能生成物创作过程中真正从事创作的主体仍然是人,只要符合作品的要件即构成作品。

李扬教授在此基础上从康德哲学中的“主客体统一认识论”和“人是目的”视角出发进一步强化论证了这一观点。李扬教授认为无论人工智能发展到何种阶段,只能作为人利用的客体和工具,永远无法拟制与人享有平等的地位,应根据作品要件判断人工智能生成物是否属于作品,根据现今著作权法理论判断人工智能生成物的权利归属于人工智能设计者或者使用者。[7]

以熊琦教授为代表的“意志代表说”认为 ,借鉴法人作品的制度安排,认为“人工智能生成成果可视为是代表设计者或训练者意志的创作行为,因此以代表所有者意志创作为理由,应将著作权归属于人工智能所有者享有。”[8]

以“创制者说” 则认为,应摒弃“人类中心主义”且采客观的读者主义的独创性判断标准,只要人工智能生成物是机器人独立完成的并符合作品的要件,就应受到著作权的保护。

由于人工智能不能像法人或者自然人一样行使权利和承担责任,应由他的创制者人工智能的创造人或者所有人行使。[9]

以黄玉烨学者为代表的“孳息说”认为 ,该说从民法的角度,认为人工智能生成物是人工智能产生的孳息,是独立于原物所生的新物,这种观点与“工具说”类似。[10]

(三)实务界关于人工智能生成物能否构成作品的观点

司法实践层面,对于人工智能生成物的保护亦有观点不一致的判例。

1.菲林诉百度案

北京互联网法院认为:

涉案文章中的图形是基于数据由软件自动生成的,图形形状的不同是基于数据差异产生,而非基于创作产生,因此涉案文章中的图形没有独创性,因此不构成作品。

其次,对于威科先行库自动生成的分析报告,从分析报告生成过程看,选定相应关键词,使用“可视化”功能自动生成的分析报告,其内容涉及对电影娱乐行业的司法分析,符合文字作品的形式要求,涉及的内容体现出针对相关数据的选择、判断、分析,具有一定的独创性 。但是,独创性并非构成文字作品的充分条件。根据《著作权法》,自然人创作仍应是著作权法上作品的必要条件,不宜突破。

分析报告是由威科先行库利用输入的关键词与算法、规则和模板结合形成的,某种意义上讲可认定威科先行库“创造”了该分析报告。但因分析报告不是自然人创作,即使具有独创性,仍不是著作权法意义上的作品。因此,即使威科先行库“创作”的分析报告具有独创性,该分析报告仍不是著作权法意义上的作品,依然不能认定威科先行库是作者并享有著作权法规定的相关权利。由此不难看出,北京互联网法院认为自然人创作完成仍应是著作权法上作品的必要条件,因此不认为人工智能生成物具有独创性。

2.腾讯诉盈讯案

深圳南山法院认为: 首先,涉案文章由原告主创团队人员运用Dreamwriter软件生成,其外在表现符合文字作品的形式要求,其表现内容体现出对当日上午相关股市信息、数据的选择、分析、判断,文章结构合理、表达逻辑清晰,具有一定的独创性。其次,涉案文章的生成过程主要经历数据服务、触发和协作、智能校验和智能分发四个环节,而在上述环节中,数据类型的输入与数据格式的处理、触发条件的设定、文章框架模板的选择和语料的设定、智能校验算法模型的训练等均由主创团队相关人员选择与安排。因此,该文章的表现形式是由原告主创团队相关人员个性化的安排与选择所决定的,其表现形式并非唯一,具有一定的独创性 。

法院认为从涉案文章的外在表现形式与生成过程来分析,该文章的特定表现形式及其源于创作者个性化的选择与安排,并由Dream writer软件在技术上“生成”的创作过程均满足著作权法对文字作品的保护条件,因此,法院认定涉案文章属于我国著作权法所保护的文字作品。 不难看出,深圳市南山区法院突破了“自然人创造应是著作权法上作品的必要条件”这一观点。

3.案例评析

但与学术界的争议不同的是,无论是菲林诉百度案,还是腾讯诉盈讯案,均认可了人工智能生成物具有一定程度的独创性。不过从前述的分析中可以看出,两案在裁判思路和裁判结果上存在较大分歧。

主要分歧在于:一是独创性的判断标准不同;二是人工智能生成物创作过程的范围认定不同 。菲林诉百度案中采用的独创性判断标准为:“独立创作”+“读者主义的创造性判断标准”;而腾讯诉盈讯案中则为“独立创作”+“作者主义的创造性判断标准”。

在菲林诉百度案中 ,法院认为某一表达只需满足独立创作和该表达对于读者来说体现出针对相关数据的选择、判断、分析,就具有独创性,而不论这种选择和判断是机器生成的还是自然人创造的。但是奇怪的是,菲林诉百度案在独创性的判断标准上持客观的读者视角,不拘泥于这种创造性的来源,但是在最终判断构成作品上又因为该表达不是自然人创作的而不构成作品。这种前后不一的立场体现出法院面对人工智能生成物时矛盾的心理,既想保护人工智能生成物内容,又不愿意突破传统著作权法的既定框架 。承认人工智能生成物具有一定的创造性是对人工智能生成物保护的理论依据,认定人工智能生成物缺乏自然人创作要见不构成作品,又是对传统著作权法的坚守。

而腾讯诉盈讯案中 ,法院认为只有满足作者独立创作和体现自然人个性化的选择和判断的表达才具有独创性。这其实是“工具论”的典型代表。腾讯诉盈讯案在坚持主观的作者视角下的独创性标准基础上,通过扩大人工智能生成物创作过程的范围至人工智能设计、使用的整体过程。这样来强化表达中蕴含着的人的因素,强化其中包含的体现人个性化的选择和判断,最终认定人工智能生成物构成作品。

3 人工智能生成物的权属

在著作权相关法律文件中,并没有对于人工智能生成物权属的具体规定。因此,在学术界和实务界对此问题也存在争议。

(一)学术界关于人工智能生成物权属的观点

在学术界,大多数学者认为人工智能生成物具有巨大的经济价值,能为著作权市场带来正向的效益,应对其进行保护。在此基础上,学界的争论聚焦在人工智能生成物应进行何种的制度设计,相关权利归属给哪一方更有利于促进文化内容市场的丰富。

关于人工智能生成内容的权属问题,学界主要存在三种不同的观点:

1.“作品—著作权说”

该观点认为, 人工智能生成内容应为具独创性且有人格要素的作品。在人机合成创作的情况下, “ 机器作者” 与人类作者都对作品作出实质性贡献, 其著作权归属可参照法人作品规定或创作者约定处理。[11]

2.“投资—邻接权说”

该观点认为,人工智能创作物因投资人的“非创作性”投入而产生, 投资人的利益应当成为相关法律制度的保护重心。广义的邻接权客体包含了那些有思想表达但又不构成作品的内容。因此,对人工智能创作物,应设计一种新的邻接权进行保护。

在此基础上,陶乾教授认为 对于人工智能生成物的权利归属,在无当事人的约定的前提下,应将该邻接权归属于人工智能使用者。因为给予人工智能设计者(所有者)对程序的著作权法保护已经足够产生激励作用,没有必要再使其对程序生成内容主张权利;人工智能设计者(所有者)只是使得程序生成内容具有了可能性, 但其并非客观上使该成果得以生成;而将人工智能生成物的邻接权赋予人工智能使用者更有助于改成果的传播,有助于实现著作权法的立法目标。[12]

3.“孳息—所有权说”

该观点从民法理论的视角认定人工智能生成物是人工智能这种物而生的新物。该智能创作物的权利归属, 可兼采罗马法上的“ 原物主义” 原则与日耳曼法上的“ 生产主义原则” , 认定人工智能的开发者、 使用者或者所有者为著作权人。

(二)实务界关于人工智能生成物权属的观点

1.菲林诉百度案

北京互联网法院认为:

创作者既不是软件研发者、也不是软件使用者,但人工智能生成物有保护的必要性,可以作为一种权益保护,并归属于予软件使用者。

对于软件研发者:软件开发者(所有者)没有根据其需求输入关键词进行检索,该分析报告并未传递软件研发者(所有者)的思想、感情的独创性表达,故不应认定该分析报告为软件研发者(所有者)创作完成。

对于软件使用者:软件用户仅提交了关键词进行搜索,应用“可视化”功能自动生成的分析报告亦非传递软件用户思想、感情的独创性表达,故该分析报告亦不宜认定为使用者创作完成 。

因此,北京互联网法院认为,对于有关人工智能生成物的署名问题,无论是软件研发者(所有者)还是使用者,非创作者都不能以作者身份署名 ,应从保护公众知情权、维护社会诚实信用和有利于文化传播的角度出发,在分析报告中添加生成软件的标识,标明系软件自动生成。

同时,北京互联网法院认为,人工智能生成物,虽然不构成著作权法意义上的作品,但是也不意味着其可以进入公有领域被自由使用。法院认为,给予软件使用者一定的合法权益,有利于使得投入成果(即分析报告)的得到进一步的传播。

而对于软件研发者(所有者)来说,其利益可通过收取软件使用费用等方式获得,其开发投入已经得到相应回报;如果将分析报告的相关权益赋予软件研发者(所有者)享有,软件研发者(所有者)并不会积极应用,不利于文化传播和科学事业的发展。

但这个相关权益究竟如何定义,法院没有明确,法律法规也未有规定,有待进一步探讨。

2 .腾讯诉盈讯案

深圳市南山区法院认为:权属遵从“约定”。

在深圳市南山区法院的判决书中,法院写道:“考虑到本案的实际情况以及软件著作权人已和原告约定其使用授权软件所创作的作品的著作权归原告所有,已无查明必要,在所不问”。因此,不难看出法院认为可以通过约定的方式来明确软件使用者为使用软件所创作的作品的著作权人。但在没有约定的情况下,人工智能生成物的权属怎么设定并没有提及。

4 人工智能生成物的保护路径

在菲林诉百度案中,北京互联网法院认为生成报告虽然不构成作品,但应作为人工智能使用者享有的一种权益进行保护。这个相关权益究竟如何定义,法院没有明确,法律法规也未有规定,有待进一步探讨。在腾讯诉盈讯案中,法院认为人工智能生成物构成作品,其保护路径理应同一般作品。

在学界中,由于学者对于人工智能生成物权属的观点不一,导致所采取的保护路径也各不相同 。主要的观点如下:

1.“作品—著作权说”流派

其中,吴汉东教授认为 ,可以建构“ 作者—著作权人” 的二元权利主体结构, 对创作主体资格与权利主体资格实行界分, 即作者未必是第一著作权人。并且基于“ 算法创作” 的事实, 未来法律可以拟制“ 机器作者”,而著作权人相关权利则由权属者来实施。[11]

而杨利华教授认为 ,加强对人工智能生成物的保护同时也应对其进行限制,以维持著作权法的利益衡平。提出应修改立法对人工智能生成物权利客体范畴的进行清晰界定;降低人工智能生成物作品的保护期限;为保护自然人创作市场,人工智能生成物应附随强制署名义务;并设定法定许可模式以突破机器阅读者在合理使用中的困境。[14]

孙文学者则认为,人工智能生成物应该归属于人工智能设计者(所有者),但此种权属构造又会对人工智能利用者及其控制第三人的使用产生一定的阻碍,此时应通过立法上的权利移转的方式将设计者对生成物的著作权转移给生成物利用者,同时对著作权的权属规则做出一定调整。[15]

2.“投资—邻接权说”流派

其中陶乾教授认为 ,应设定一种归属于人工智能使用者的新邻接权——数据处理者权来保护不构成作品的人工智能生成物。其次,应对该邻接权进行限制,如数据成果的保护期应短于著作财产权的保护期和一般邻接权的保护期。最后,关于权利的行使, 鉴于人工智能生成成果本身来源于其程序对已发表作品和信息的深度学习,因此不应限制其他主体运用技术对人工智能生成成果进行再次提取和利用。[16]

3.“孳息—所有权说”流派

该流派认为应按照民法中的物权理论进行保护和流转。

5 人工智能生成物的侵权责任?

虽然人工智能的研究成为学界的学术热点,但其中有关人工智能生成物侵权责任分配的学术研究成果较少,目前主要有以下几种观点:

(一)用人者责任说

用人者责任又可以被称为“雇主责任”,属于替代责任的范畴,指的是如果雇员在职务范围内实施侵害他人权益的行为,那么雇主就需要对雇员的行为承担责任。用人者责任说提出,人工智能自主运行行为是为执行特定任务,所有者或使用者为其运行利益的享有者。即如果智能机器人实际上“代理或者代表”某个法律主体从事行为或者进行决策,那么可以比照雇主对雇员的责任,让部署智能机器人的人承担替代责任。如贝札尔等人指出,谁“雇佣”谁负责应当是基本原则。用人者责任中,责任主体承担无过错责任。[17]此外,还有一种特殊的用人者责任——劳务派遣责任。2017年2月,欧洲议会《机器人民事法律规则》就是基于劳务派遣关系进行的责任构造。该理论基础在于用工单位直接享受劳动者劳动成果带来的利益,因此对比用人单位,应承担更为严苛的侵权责任。

(二)代理—委托关系说

就人工智能生成物侵权的责任而言,目前有一种理论是将其按照代理-委托关系处理,将Al程序视作为委托人完成任务的代理人。委托人控制Al的生产方式和内容。如果Al产生的工作是委托人不喜欢的,委托人可以修改人工智能的现有指令以反映委托人的愿望。最终,委托人是从人工智能创造的工作中受益的人。因此,当代理人制作的作品受到版权侵犯时,委托人应该为该侵权行为对受害方负责。

(三)法律主体责任说

1.类比自然人的有限人格——监护人责任

监护人理论认为人工智能具备一定的自主性,但又不能完全像人类一样独立地思考和行为,其类似于人类社会中的无或者限制民事行为能力人,使用者如果使用该人工智能,对人工智能的自主行为负有监督管理的义务,应当承担人工智能的监护人责任。赖玉强提出,人工智能是人类创造出来的服务于自身的,其地位不可能超出人类,甚至不能达到与人类同等重要的程度。它所能拥有的,至多只是有限的民事行为能力以及民事权利能力,这种能力在一定程度上可类比于未成年人,是“类人”。所以,所有者应当对人工智能承担监护人的责任。[18]

2.类比法人的有限人格——设立中法人和电子人制度

刘晓纯、达亚冲学者提出智能机器人享有有限法律权利,即可以成为中法人。[19]贝克则主张在人与工具之间设立新的主体,即把与智能机器人相关的所有参与者(研发者、程序员、生产者、用户)全部绑定起来,转化为一个新的法律实体——“电子智能体”(electronic agent)或“电子人”(electronic person)。他认为法人概念在处理公司事务时是相当成功的,至少能够确保由公司各方的合作行为造成的全部损失不是由某个人来独立承担。因此可以赋予智能机器人特定的法律“人格”,让自主机器人有一定程度的法律自主权。这种观点与从属法律主体地位理论有一致性。

3.直接赋予人工智能法律主体地位

不少学者从法律主体理论出发,提出直接赋予人工智能法律主体资格不存在学理和伦理上的困境。周详学者认为,以往有很多先例可循的“社会人格化”例证,足以说明如今我们若将智能机器人“人格化”,在逻辑上并不存在法律推理与论证方法层面的根本性障碍。权利主体的内容是逐步建构起来的,是一个不断发展变化的观念。智能机器人的智能性这一本质性要素,必然要求赋予智能机器人法律主体地位,从而对社会发展起到正向作用。因此赋予智能机器人法律主体地位是顺应时代发展的要求。如许中缘提出民法上确认法人的民事主体人格。[20]张童学者提出法律关系主体与客体的区分依据并非局限于是否拥有生命、是否拥有独立意志,而是应当将重点放在衡量有无必要赋予主体资格使其享有权利能力,如法人拥有拟制人格那般,赋予人工智能产品以拟制人格并非不可。在不限制其他法律主体(自然人和人工开发的法律实体)的利益的最佳保护的情况下,人工智能系统应该是公认的法律主体。所以,在知识产权法领域,有学者基于人工智能的法律主体地位,提出可以赋予人工智能创造物以著作权。[21]

以上综述可知,对于人工智能生成物的法律保护问题,仍众说纷纭。但无论法律上存在何种争议,人工智能已经不可阻挡地走入我们的工作和生活。 不信,您看:

参考文献

[1] 参见北京菲林律师事务所诉北京百度网讯科技有限公司侵害署名权、保护作品完整权、信息网络传播权纠纷案,北京互联网法院(2018)京0491民初239号民事判决书。

[2] 参见深圳市腾讯计算机系统有限公司诉上海盈讯科技有限公司侵害著作权及不正当竞争纠纷案,深圳南山区人民法院(2019)粤0305民初14010号民事判决书。

[3] 参见王迁:《论人工智能生成的内容在著作权法中的定性》,载《法律科学(西北政法大学学报)》2017年第5期。

[4] 参见邱润根、曹宇卿:《论人工智能 “创作”物的版权保护》,载《南昌大学学报(人文社会科学版)》2019年第2期。

[5] 参见刘银良:《论人工智能作品的著作权法地位》,载《政治与法律》2020年第3期。

[6] 参见陶乾:《论著作权法对人工智能生成成果的保护——作为邻接权的数据处理者权之证立》,载《法学》2018年第4期。

[7] 参见李扬、李晓宇:《康德哲学视点下人工智能生成物的著作权问题探讨》,载《法学杂志》2018年第9期。

[8] 参见熊琦:《人工智能生成物的著作权认定》,载《知识产权》2017年第3期。

[9] 参见吴汉东:《人工智能时代的制度安排与法律规制》,载《法律科学(西北政法大学学报)》2017年第5期。

[10] 参见黄玉烨、司马航:《孳息视角下人工智能生成作品的权利归属》,载《河南师范大学学报(哲学社会科学版)》2018年第4期。

[11] 参见吴汉东:《人工智能生成作品的著作权法之问》,载《中外法学》2020年第3期。

[12] 参见前引[6]。

[13] 参见前引[11]。

[15] 参见杨利华:《人工智能生成物著作权问题探究》,载《现代法学》2021年第4期。

[15] 参见孙文:《人工智能生成物的著作权保护路径研究》, https://mp.weixin.qq.com/s/WDfJml3sUxjlmOHrFAPDMw ,2023年2月14日最后访问。

[16] 参见前引[6]。

[17] 参见前引[9]。

[18] 参见赖玉强、袁秀洋:《人工智能侵权的责任承担困境与出路探究》,载《重庆广播电视大学学报》2019年第1期。

[19] 参见刘晓纯,达亚冲:《智能机器人的法律人格审视》,载《前沿》2018年第3期。

[20] 参见成素梅,高诗宇:《智能机器人应有法律主体资格吗? 》,载《西安交通大学学报(社会科学版) 》2020年1期。

[21] 参见张善根:《人工智能从属法律主体论的理论基础与技术甄别》,载《求索》2021第6期。

Introduction

The emergence of ChatGPT has sparked global interest in generative AI content (AIGC). From a legal perspective, AIGC raises complex questions across copyright, liability, data protection, and regulatory frameworks. This article examines the fundamental legal issues.

I. Copyright Issues

1. Does AI-Generated Content Qualify for Copyright Protection?

Chinese copyright law protects “original intellectual achievements of the human mind” expressed in certain forms. The key question is whether content generated by AI, without direct human creative input, can qualify for protection.

Current Chinese law does not explicitly address AI-generated works. The national copyright law revision draft has proposed acknowledging AI-generated content, but no final legislation has been enacted.

2. Ownership of AI-Generated Works

If AI-generated content qualifies for protection, who owns the copyright?

- The AI developer?

- The AI operator or platform?

- The user who provided the prompt?

3. Copyright Infringement in Training Data

AI systems are trained on vast datasets that may include copyrighted works. Questions arise:

- Does training on copyrighted works without authorization constitute infringement?

- Do copyright exceptions for computational analysis apply?

- What constitutes fair use in AI training contexts?

II. Legal Liability Issues

1. Liability for AI-Generated Content

When AI generates harmful, misleading, or illegal content, who bears responsibility?

- The AI developer for system design flaws?

- The operator for deployment decisions?

- The user for input choices?

- Or shared responsibility?

2. Product Liability

Could AI systems be considered products subject to product liability regulations if they generate harmful outputs?

3. Tort Liability

Operators of AI systems may face tort liability under general principles if AI-generated content causes harm to others.

III. Data Privacy and Security

1. Personal Data in Training

AI training datasets may include personal data. Compliance with China’s Personal Information Protection Law (PIPL) requires:

- Lawful basis for data processing

- Consent where required

- Data minimization principles

- Security obligations

2. Cross-Border Data Transfers

For AI systems with international components, cross-border data transfer requirements under PIPL and related regulations apply.

3. Data Security in AI Systems

AI systems must implement appropriate security measures to prevent unauthorized access, data breaches, and system manipulation.

IV. Regulatory Framework Development

1. Generative AI Regulations

China’s interim measures for generative AI services (2023) require:

- Compliance with laws and regulations

- Respect for intellectual property

- Accuracy and reliability of generated content

- Protection of personal information

- Security assessment and algorithm filing for certain services

2. Algorithmic Recommendation Regulations

AI content recommendation systems are subject to the “Regulations on the Management of Algorithmic Recommendations in Internet Information Services,” requiring transparency and user rights protection.

3. Future Regulatory Trends

Anticipated regulatory developments include:

- Specific AI legislation

- Enhanced transparency requirements

- Mandatory safety assessments

- International regulatory cooperation

V. Recommendations for AI Developers and Operators

-

Copyright compliance: Conduct due diligence on training data sources and licensing arrangements.

-

Content governance: Establish content review mechanisms and risk management systems.

-

Data compliance: Ensure PIPL compliance throughout the AI development and deployment lifecycle.

-

Transparency: Implement appropriate disclosure of AI-generated content and system capabilities.

-

Liability allocation: Clearly define contractual liability allocation with users, customers, and partners.